Mercoledì scorso le azioni di Alphabet, l’azienda che detiene il controllo di Google, hanno perso oltre 100 miliardi di capitalizzazione dopo che è emerso un errore piuttosto grave nella prima dimostrazione delle funzioni di Bard, il nuovo chatbot basato sull’AI annunciato lunedì scorso.

Il nuovo servizio, che andrà a porsi in diretta competizione e confronto con ChatGPT di OpenAI, sarà disponibile al pubblico “nelle prossime settimane”; per ora l’accesso è limitato a un insieme limitato di utenti di fiducia, che hanno quasi certamente firmato accordi di non divulgazione perché non è ancora trapelato nulla sulle effettive potenzialità di questa nuova intelligenza artificiale.

Le uniche dimostrazioni disponibili sono quelle proposte da Google sotto forma di screenshot e animazioni Gif, e proprio una delle primissime demo ha causato lo scompiglio che ha avuto riflessi perfino in borsa.

Bard is an experimental conversational AI service, powered by LaMDA. Built using our large language models and drawing on information from the web, it’s a launchpad for curiosity and can help simplify complex topics → https://t.co/fSp531xKy3 pic.twitter.com/JecHXVmt8l

— Google (@Google) February 6, 2023

Il telescopio Webb

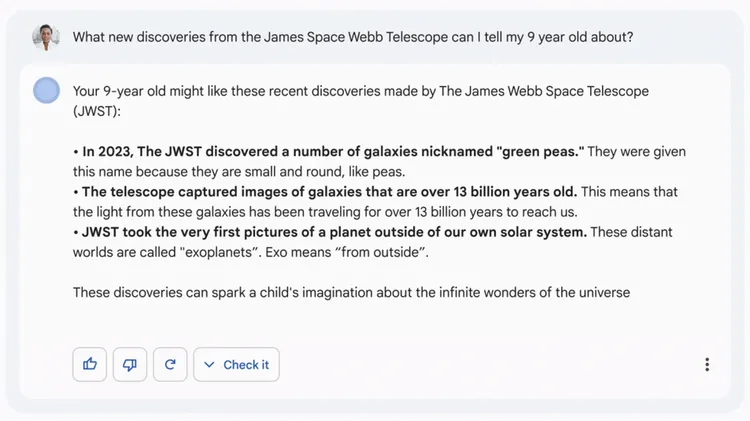

L’animazione mostra infatti Bard che risponde alla richiesta “What new discoveries from the James Webb Space Telescope can I tell my 9 year old about?”, ossia Di quali scoperte del telescopio spaziale Webb posso parlare a mio figlio di 9 anni?

La risposta di Bard suggerisce tre argomenti, l’ultimo dei quali sostiene che il telescopio ha scattato le prime fotografie di un pianeta fuori dal sistema solare.

L’animazione, pubblicata su Twitter, ha scatenato un fiume di risposte da numerosissimi appassionati e da diversi astronomi di fama, tra cui l’astrofisico di Harvard Grant Tremblay e il direttore degli osservatori dell’Università della California Bruce Macintosh.

Speaking as someone who imaged an exoplanet 14 years before JWST was launched, it feels like you should find a better example?

— Bruce Macintosh (@bmac_astro) February 8, 2023

La notizia è stata ripresa da numerosissimi organi di informazione, tra cui l’agenzia Reuters, e ha rinfocolato il dibattito sull’affidabilità dei sistemi basati sull’intelligenza artificiale nei contesti in cui è richiesta innanzi tutto la massima affidabilità.

Clarissa Véliz dell’università di Oxford ha commentato: “Questo episodio mostra perfettamente la debolezza più importante dei sistemi statistici. Questi servizi sistemi sono progettati per dare risposte plausibili, a seconda dell'analisi statistica – non per offrire risposte veritiere”.

Un portavoce di Google ha dichiarato al sito New Scientist: "L’episodio evidenzia l'importanza di un rigoroso processo di test, che stiamo iniziando questa settimana con il nostro programma Trusted Tester. Combineremo il feedback esterno con i test interni per assicurarci che le risposte di Bard soddisfino un livello elevato di qualità, sicurezza e fondatezza”.