Stability AI ha rilasciato la nuova versione di Stable Diffusion che, tra le altre novità, aggiunge la feature depth2img, un nuovo modello per la definizione della profondità nei processi IA di image-to-image.

Il modello inferisce la profondità di un'immagine di input e ne genera di nuove mantenendo la struttura originaria, senza perdere informazioni. La nuova feature permette di trasformare totalmente l'immagine senza alterare la coerenza e la profondità dell'originale.

A differenza dei modelli precedenti, dove le uniche informazioni disponibili erano quelle dei pixel e delle definizioni testuali, ora la generazione di immagini si arricchisce di nuovi dettagli per preservare le caratteristiche dell'input.

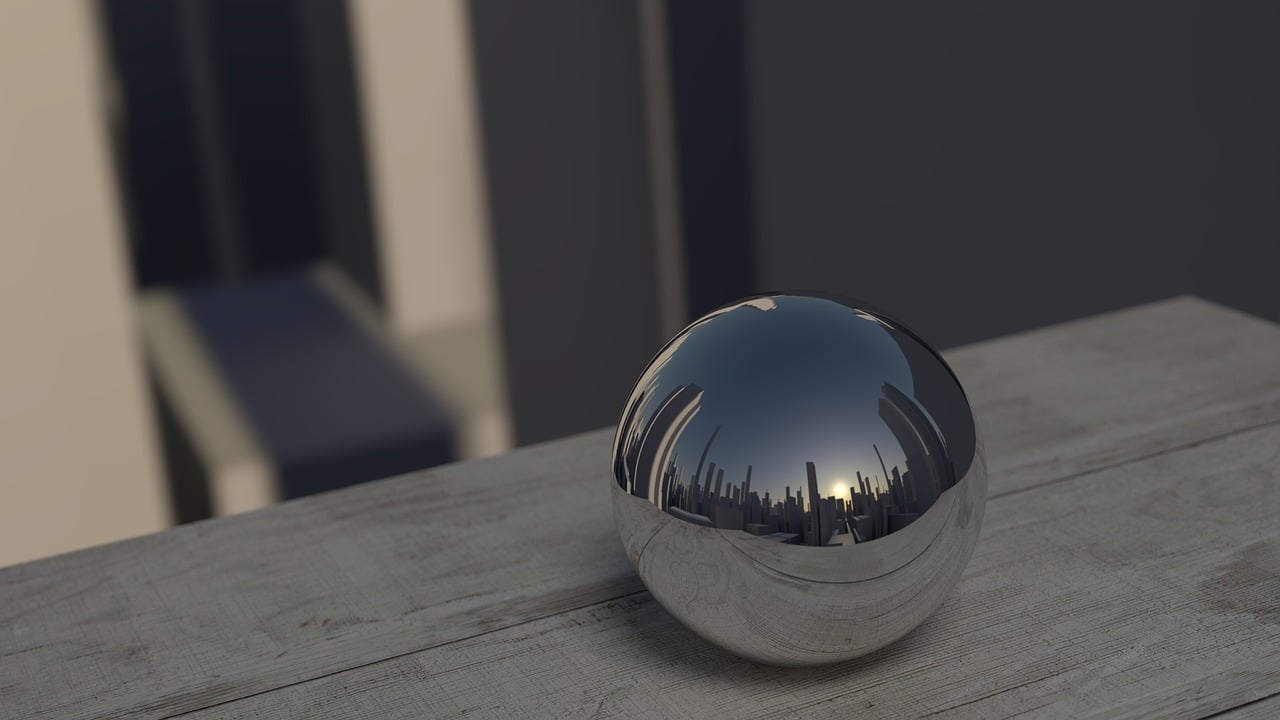

Il modello genera una mappa di profondità simile a quella usata dagli smartphone per l'effetto sfocatura Bokeh nelle foto, per risaltare il soggetto della foto rispetto al background.

Depth2img usa MiDas di Intel, un modello per il calcolo della profondità relativa di un'immagine. Si parla in questo caso di monocular depth estimation, ovvero della stima della profondità di un singolo pixel in relazione alla telecamera della scena. Questo passaggio è fondamentale per calcolare la coerenza dell'ambiente.

La potenza dell'approccio può essere sfruttata non solo nei task di image-to-image, ma anche per la ricostruzione 3D delle scene, anche in ambito cinematografico, i sistemi di guida autonoma e di realtà aumentata.