Un gruppo di ingegneri di Google ha sviluppato e presentato un nuovo sistema di intelligenza artificiale dedicato alla generazione di musica, chiamato MusicLM.

Nel documento che ne descrive le capacità, pubblicato sul sito dedicato ai documenti accademici arXiv, il gruppo sostiene che il sistema raggiunge nuove vette nelle capacità di composizione e nella fedeltà sonora delle canzoni prodotte dall’intelligenza artificiale.

MusicLM non è l’unico sistema automatico indirizzato alla creazione musicale, ma i risultati generati dai suoi concorrenti (come Dance Diffusion o Riffusion) sono molto primitivi e difficilmente potrebbero essere scambiati per brani e registrazioni autentiche, anche a un orecchio distratto.

Da questo punto di vista, le soluzioni di AI generativa dedicate alla produzione di brani musicali risultano molto indietro rispetto alle capacità mostrate in altri contesti, come la creazione di immagini o la generazione di testi.

Descrivere i brani

Il team di Google afferma che il loro nuovo sistema supera le soluzioni precedenti, sia nella qualità delle canzoni prodotte sia nella loro aderenza alle richieste che, come è diventato ormai comune, vengono comunicate all’AI tramite prompt testuali.

Gli sviluppatori propongono un gran numero di esempi sul sito ufficiale del progetto, all’interno della sezione Github di Google Research. In molti casi, è notevole in particolare la capacità di interpretare prompt molto lunghi, complessi e ricchi di dettagli.

Il sistema accetta anche richieste specifiche, come la presenza di determinati strumenti o un particolare genere. Può anche generare cori o melodie vocali, anche se i risultati non sono molto coerenti per quanto riguarda il significato dei testi.

Dal punto di vista della fedeltà e della verosimiglianza, i brani e i generi basati su suoni sintetici (per esempio la musica elettronica o il rap) garantiscono in genere risultati migliori rispetto a quelli che utilizzano strumenti tradizionali, con un timbro sono più definito e familiare per l’orecchio umano.

Curiosi (e in media piuttosto azzeccati) sono anche i brani musicali generati condizionando il sistema tramite alcuni celebri dipinti, in modo da replicarne in forma sonora le atmosfere.

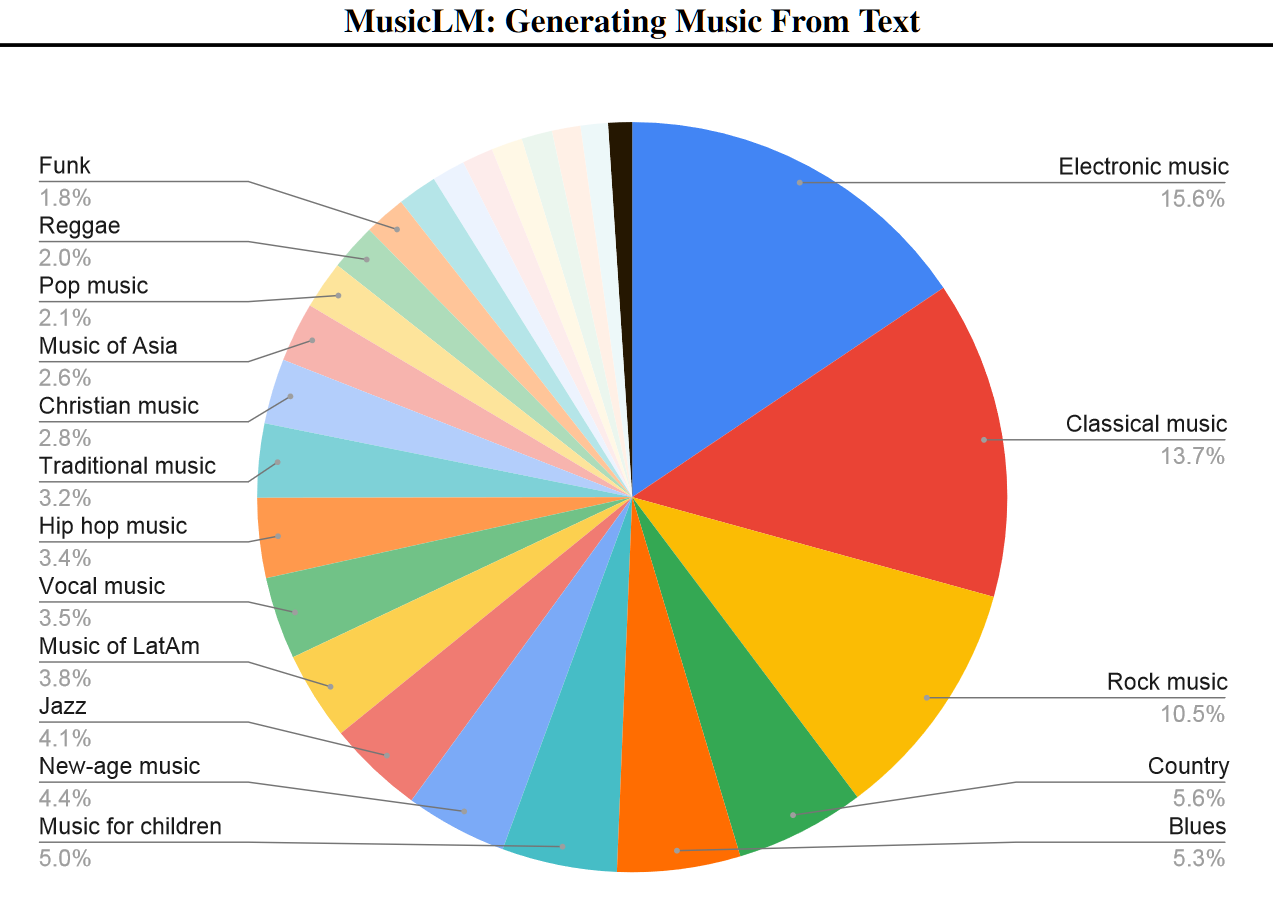

Il sistema è stato addestrato utilizzando il dataset MusicCaps, che include 28.000 ore di brani musicali, e può produrre output di lunghezza variabile, da semplici jingle a composizioni caratterizzate da più movimenti, come accade spesso nella musica classica e sinfonica.

Google non renderà disponibile MusicLM per l’uso generale. I test hanno infatti mostrato che come circa l'1% della musica generata dal sistema possa essere fatta risalire direttamente a un artista umano, e quindi potrebbe causare problemi di copyright.